Mit der rasanten Entwicklung künstlicher Intelligenz stehen wir vor einer Vielzahl ethischer Herausforderungen. Diese reichen von Fragen der Transparenz und Fairness bis hin zu tiefgreifenden philosophischen Überlegungen zur Mensch-Maschine-Beziehung. In diesem Artikel untersuchen wir die wichtigsten ethischen Aspekte der KI-Entwicklung.

Die Grundpfeiler der KI-Ethik

Die ethischen Fragen rund um künstliche Intelligenz lassen sich auf einige Kernprinzipien zurückführen, die als Leitlinien für die verantwortungsvolle Entwicklung und den Einsatz von KI dienen sollten:

Transparenz und Erklärbarkeit

Ein grundlegendes ethisches Prinzip ist die Transparenz von KI-Systemen. Nutzer sollten verstehen können, wie KI-Entscheidungen zustande kommen, insbesondere wenn diese Entscheidungen bedeutende Auswirkungen auf ihr Leben haben. Dies stellt eine besondere Herausforderung bei komplexen Deep Learning-Systemen dar, die oft als "Black Box" funktionieren.

Die Europäische Kommission hat in ihren Ethik-Leitlinien für vertrauenswürdige KI betont, dass KI-Systeme nachvollziehbar sein müssen: "Prozesse müssen transparent sein, die Fähigkeiten und der Zweck von KI-Systemen offen kommuniziert werden, und Entscheidungen sollten – so weit wie möglich – für die Betroffenen erklärbar sein."

Fairness und Nicht-Diskriminierung

KI-Systeme können Vorurteile und Diskriminierungen aus Trainingsdaten übernehmen und verstärken. Dies kann zu unfairen Ergebnissen führen, die bestimmte Bevölkerungsgruppen benachteiligen. Die Sicherstellung von Fairness erfordert sorgfältige Datenauswahl, kontinuierliche Überwachung und Korrektur von Verzerrungen.

Visualisierung von Fairness und Verzerrungen in KI-Systemen

Privatsphäre und Datenschutz

KI-Systeme arbeiten oft mit großen Mengen persönlicher Daten, was Fragen zum Datenschutz und zur Privatsphäre aufwirft. Es muss ein Gleichgewicht gefunden werden zwischen der Nutzung von Daten zur Verbesserung von KI-Systemen und dem Schutz der Privatsphäre von Individuen.

Verantwortlichkeit und Haftung

Bei Schäden durch KI-Systeme stellt sich die Frage: Wer trägt die Verantwortung? Der Entwickler, der Anwender, das Unternehmen oder gar das KI-System selbst? Diese Frage wird zunehmend relevant, je autonomer KI-Systeme werden.

"Die ethischen Herausforderungen der KI-Entwicklung erfordern einen interdisziplinären Ansatz, der technische, rechtliche, philosophische und soziale Perspektiven integriert."

- Prof. Dr. Sabine Meyer, Ethikerin an der Universität BerlinKonkrete ethische Herausforderungen in verschiedenen Bereichen

KI im Arbeitsleben

Die Automatisierung durch KI wird zahlreiche Arbeitsplätze verändern oder ersetzen. Dies wirft Fragen zur Zukunft der Arbeit, zur Umschulung von Arbeitnehmern und zur gerechten Verteilung der wirtschaftlichen Vorteile von KI auf.

Ein konkretes Beispiel ist der Einsatz von KI bei Einstellungsentscheidungen. Wenn Algorithmen über Bewerbungen entscheiden, besteht die Gefahr, dass sie bestehende Vorurteile verstärken. Der Fall eines großen Technologieunternehmens, dessen KI-Rekrutierungstool männliche Kandidaten bevorzugte, weil es mit Daten trainiert wurde, die einen historischen Bias widerspiegelten, zeigt diese Problematik deutlich.

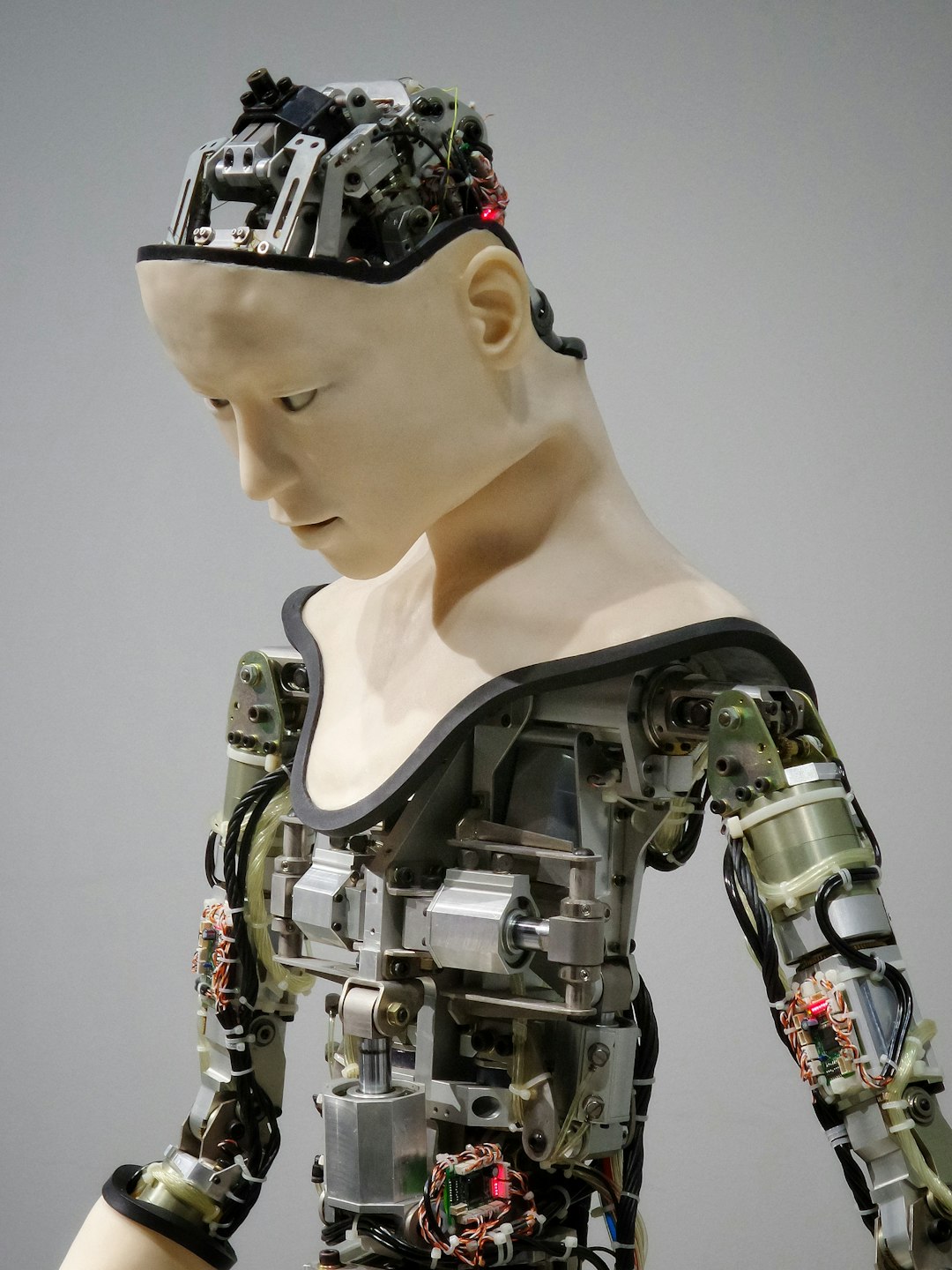

KI in autonomen Systemen

Selbstfahrende Autos, autonome Waffensysteme und andere autonome Technologien stellen uns vor komplexe moralische Dilemmata. Wie soll ein selbstfahrendes Auto in einer unvermeidbaren Unfallsituation entscheiden? Wer trägt die Verantwortung für Fehler?

Das bekannte "Trolley-Problem" illustriert diese ethischen Herausforderungen: Soll ein autonomes Fahrzeug in einer unvermeidlichen Unfallsituation die Insassen schützen oder die Anzahl der potenziellen Opfer minimieren? Verschiedene Kulturen und Rechtssysteme können hier zu unterschiedlichen Antworten kommen.

KI und Überwachung

KI-gestützte Überwachungstechnologien wie Gesichtserkennung bieten neue Möglichkeiten für Sicherheitsbehörden, werfen aber auch Bedenken hinsichtlich Privatsphäre und Bürgerrechten auf. Die Balance zwischen Sicherheit und Freiheit ist eine der großen ethischen Herausforderungen unserer Zeit.

KI in der medizinischen Entscheidungsfindung

KI kann Ärzten helfen, bessere Diagnosen zu stellen und Behandlungen zu planen. Doch wer trägt die Verantwortung, wenn ein KI-System einen Fehler macht? Und wie stellen wir sicher, dass der Zugang zu KI-gestützter Gesundheitsversorgung fair verteilt ist?

Ethische Risiken und Lösungsansätze in der KI

| Ethisches Risiko | Lösungsansatz |

|---|---|

| Bias und Diskriminierung | Diverse Trainingsdaten, regelmäßige Audits, diverse Entwicklerteams |

| Mangelnde Transparenz | Entwicklung erklärbarer KI, verständliche Dokumentation |

| Privatsphäreverletzungen | Datenschutz by Design, Datensparsamkeit, Verschlüsselung |

| Haftungsfragen | Klare rechtliche Rahmenbedingungen, Versicherungslösungen |

| Arbeitsplatzverlust | Umschulungsprogramme, Grundeinkommen, neue Arbeitsmodelle |

Regulatorische Ansätze und Leitlinien

Angesichts der ethischen Herausforderungen haben verschiedene Organisationen und Regierungen begonnen, regulatorische Rahmenwerke und ethische Leitlinien für KI zu entwickeln:

Die EU-KI-Verordnung

Die Europäische Union arbeitet an einer umfassenden Regulierung für KI, die risikobasierte Kategorien und entsprechende Anforderungen festlegt. Hochrisiko-KI-Anwendungen, wie solche im Gesundheitswesen oder in kritischer Infrastruktur, werden strengeren Auflagen unterliegen.

IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems

Die IEEE hat Ethik-Standards für autonome und intelligente Systeme entwickelt, die als Leitlinien für Entwickler dienen sollen.

OECD-Prinzipien für KI

Die OECD hat Prinzipien für verantwortungsvolle KI veröffentlicht, die von vielen Ländern angenommen wurden und als Grundlage für nationale Regulierungen dienen.

Die Rolle der Entwickler und Unternehmen

Entwickler und Unternehmen tragen eine besondere Verantwortung bei der ethischen Gestaltung von KI-Systemen:

Ethik im Entwicklungsprozess

Ethische Überlegungen sollten von Anfang an in den Entwicklungsprozess integriert werden, nicht erst nachträglich. Dies umfasst die sorgfältige Auswahl von Trainingsdaten, die Überprüfung auf Verzerrungen und die Implementierung von Mechanismen zur Erklärbarkeit.

Diverse Teams

Vielfältige Entwicklerteams können helfen, verschiedene Perspektiven einzubringen und potenzielle Probleme frühzeitig zu erkennen.

Ethische Unternehmensrichtlinien

Immer mehr Technologieunternehmen entwickeln interne Ethik-Richtlinien für KI und richten Ethik-Beiräte ein. Dies ist ein wichtiger Schritt, reicht aber nicht aus, wenn er nicht mit konkreten Maßnahmen und Rechenschaftspflicht verbunden ist.

Die Zukunft der KI-Ethik

Die ethischen Fragen rund um KI werden mit zunehmender Leistungsfähigkeit und Verbreitung von KI-Systemen noch komplexer. Einige Zukunftstrends und -herausforderungen:

Superintelligenz und existenzielle Risiken

Wenn KI-Systeme irgendwann menschliche Intelligenz in allen Bereichen übertreffen sollten, könnten existenzielle Risiken entstehen. Wie stellen wir sicher, dass solche Systeme mit menschlichen Werten übereinstimmen?

KI-Rechte

Mit fortschreitender KI-Entwicklung könnte die Frage aufkommen, ob bestimmte KI-Systeme Rechte oder moralischen Status verdienen. Dies führt zu tiefgreifenden philosophischen Fragen über das Wesen von Bewusstsein und moralischer Berücksichtigung.

Globale Governance

KI ist eine globale Technologie, die globale Lösungen erfordert. Die Entwicklung internationaler Standards und Regulierungen ist eine der größten Herausforderungen für die Zukunft.

Fazit: Ein ethischer Kompass für die KI-Entwicklung

Die ethischen Herausforderungen der KI sind komplex und vielschichtig. Sie erfordern einen kontinuierlichen Dialog zwischen Entwicklern, Politikern, Ethikern und der Gesellschaft als Ganzes.

Ein ethischer Ansatz zur KI-Entwicklung bedeutet nicht, den technologischen Fortschritt zu bremsen, sondern sicherzustellen, dass dieser Fortschritt dem Wohl aller Menschen dient und grundlegende Werte wie Würde, Autonomie und Gerechtigkeit respektiert.

Letztendlich geht es darum, KI als Werkzeug zu gestalten, das menschliche Fähigkeiten erweitert und unterstützt, ohne unsere Handlungsfähigkeit, Privatsphäre oder Würde zu untergraben. Dies erfordert nicht nur technische Lösungen, sondern auch gesellschaftliche Entscheidungen darüber, wie wir mit KI leben wollen.

Kommentare

Hinterlassen Sie einen Kommentar